videoEffect.duration

videoEffect.resolution

videoEffect.ratio

Générateur de Vidéos IA Open Source Wan 2.2

Découvrez la puissance de la génération de vidéos cinématographiques avec Wan 2.2 - Désormais Open Source

Qu’est-ce que Wan 2.2 ?

Wan 2.2 d'Alibaba : un générateur de vidéos IA plus rapide et plus intelligent

Wan 2.2 est un modèle IA de pointe développé par Wan AI, une initiative de recherche associée à Alibaba. Il se concentre sur la génération de contenu multimodal, en particulier la création de vidéos de haute qualité à partir de texte ou d'images. Lancé fin juillet 2025, il représente une évolution majeure par rapport à Wan 2.1, offrant de meilleures performances grâce à une architecture Mixture of Experts (MoE).

Accédez au Générateur de Vidéos IA Wan 2.2 en open-source

Alibaba Wan 2.2 est distribué sous la licence Apache 2.0 et est totalement open-source. Le modèle et ses composants sont disponibles en téléchargement et peuvent être utilisés dans des contextes de recherche comme commerciaux. Cette approche ouverte fait de Wan 2.2 une base flexible pour les développeurs créant de nouveaux outils vidéo Wan ou intégrant des flux de travail personnalisés.

Modèles de génération vidéo par IA Wan 2.2

T2V-A14B : Modèle Texte vers Vidéo

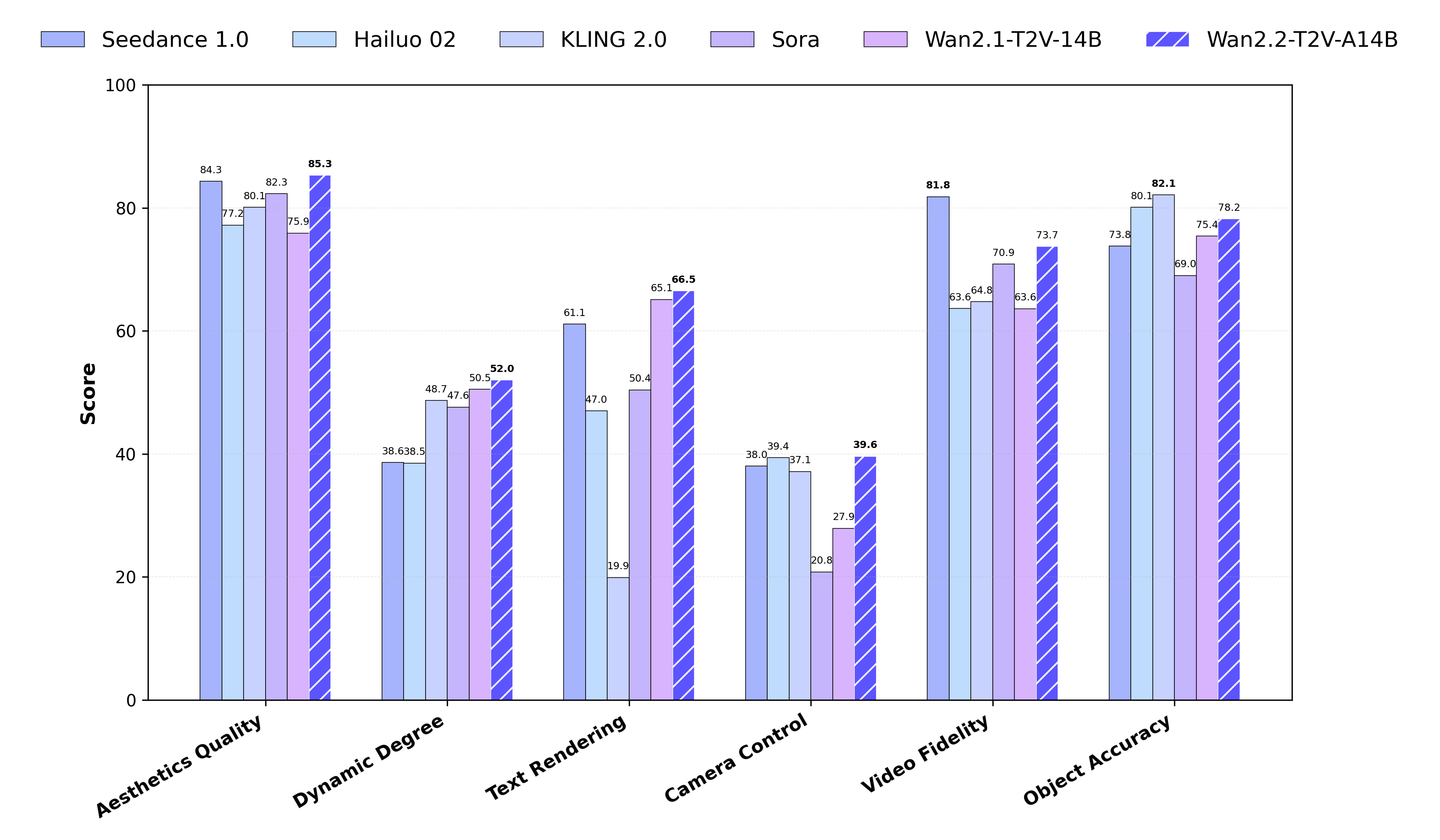

T2V-A14B est un modèle Wan 2.2 haute capacité, conçu avec une architecture Mixture-of-Experts (MoE). Il génère des vidéos de 5 secondes aux résolutions 480P et 720P. Sur le benchmark Wan-Bench 2.0, ce modèle surpasse plusieurs générateurs vidéo IA commerciaux majeurs, offrant d’excellents résultats en qualité deRééditer traduction texte mouvement, précision des prompts et style visuel.

I2V-A14B : Modèle Image vers Vidéo

Le modèle I2V-A14B est dédié à la transformation d'images statiques en séquences vidéo fluides. Également basé sur la conception MoE, il prend en charge les sorties en 480P et 720P. Comparé aux versions précédentes de Wan Vidéo, il réduit les mouvements de caméra peu naturels et offre une meilleure cohérence dans les scènes stylisées ou artistiques.

TI2V-5B : Générateur Vidéo hybride Texte et Image

TI2Re-editing translated copyV-5B est un modèle léger et puissant conçu pour les tâches de génération vidéo à partir de texte et d'image. Il utilise Wan2.2-VAE pour compresser efficacement les vidéos tout en en préservant la haute qualité. Il prend en charge la résolution 720P à 24 fps et fonctionne sur un GPU grand public comme le RTX 4090. Cela en fait l’un des modèles Wan IA les plus rapides disponibles pour un usage pratique et académique.

Fonctionnalités clés du générateur open-source de vidéos IA Wan 2.2

Contrôle cinématographique pour la création vidéo IA Wan

Wan 2.2 offre un contrôle précis de l’éclairage, des couleurs et du cadrage, permettant de créer des vidéos au style cinématographique avec une cohérence visuelle constante. Idéal pour les récits immersifs et les productions commerciales propulsés par Wan IA.

Architecture MoE avancée dans Wan 2.2

Le modèle repose sur une architecture Mixture of Experts (MoE), ce qui accélère la génération et améliore la qualité sans augmenter les ressources nécessaires. Cette innovation confère à Wan 2.2 une capacité accrue et des résultats plus stables.

Sortie haute résolution avec performance optimisée

Wan 2.2 prend en charge la génération de vidéos en 720p à 24 images/seconde sur un GPU grand public. C’est l’un des modèles les plus rapides de sa catégorie, adapté aux usages professionnels comme académiques, dans divers contextes.

Des données élargies pour un rendu plus réaliste et des mouvements fluides

Par rapport à Wan 2.1, le nouveau modèle est entraîné sur 65 % d’images et 83 % de vidéos en plus. Cela améliore la précision des mouvements, la diversité des scènes et la qualité visuelle dans tous les contenus vidéo générés par Wan.

Compatible avec les flux Texte-vers-Vidéo et Image-vers-Vidéo

Le générateur de vidéos IA Wan 2.2 transforme des instructions textuelles ou des images statiques en scènes dynamiques. Il intègre des modèles adaptés aux entrées textuelles ou visuelles.

Interprétation précise des instructions

Wan 2.2 comprend mieux les instructions complexes, y compris celles comportant plusieurs objets ou des styles artistiques. Les vidéos générées sont plus claires, fidèles et homogènes, même pour des contenus détaillés ou abstraits.

Comment accéder à Wan 2.2 en ligne ?

Essayez Wan 2.2 TI2V-5B sur Hugging Face Space

Vous pouvez tester le générateur de vidéos IA Wan 2.2 directement sur Hugging Face Space. Le modèle TI2V-5B prend en charge la conversion de texte ou d’image en vidéo, en 720p à 24 images par seconde.

Utilisez Wan 2.2 Plus sur le site officiel WanVideo

Le site officiel Wan AI donne accès à Wan 2.2 Plus, une version plus avancée du modèle avec des outils supplémentaires et des modèles de production prédéfinis. Il est conçu pour les créateurs souhaitant des workflows plus rapides et un contrôle poussé du rendu cinématographique. Veuillez noter que l’accès à Wan 2.2 Plus est actuellement payant.

Comment configurer et exécuter le Wan 2.2 en local

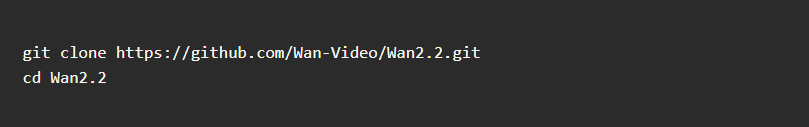

Étape 1 : Cloner le dépôt

Commencez par cloner le dépôt Git officiel de Wan 2.2 sur GitHub. Ce dépôt contient tous les fichiers nécessaires pour exécuter le modèle en local.

Étape 2 : Installer les dépendances

Après avoir cloné le dépôt, installez les bibliothèques nécessaires. Wan AI nécessite Python et PyTorch 2.4.0 ou une version supérieure pour fonctionner correctement. Cela permet d'assurer un fonctionnement fluide du générateur de vidéos IA Wan 2.2 sur votre système.

Étape 3 : Télécharger le modèle

Choisissez le modèle adapté à vos besoins : - T2V-A14B : texte vers vidéo - I2V-A14B : image vers vidéo - TI2V-5B : hybride (texte + image), compatible avec une résolution 720p à 24 images/seconde Vous pouvez en savoir plus et télécharger chaque modèle sur Hugging Face et ModelScope.

Étape 4 : Génération de vidéo

Une fois la configuration terminée, vous pouvez générer des vidéos en saisissant une instruction — qu’il s’agisse d’une phrase ou d’une image. Le système Wan 2.2 d’Alibaba traite votre entrée localement et génère une vidéo en haute résolution, avec un contrôle total sur le mouvement, la composition et le style.

Obtenez le flux de travail Wan 2.2 ComfyUI

Workflow Wan 2.2 TI2V-5B pour ComfyUI

Ce workflow prêt à l’emploi pour ComfyUI permet d’utiliser Wan 2.2 TI2V-5B pour générer des vidéos hybrides à partir de texte et d’images, grâce à une interface graphique intuitive. Pour les instructions d’installation et d’utilisation, consultez le tutoriel Wan 2.2 ComfyUI disponible en ligne. Il est recommandé d’utiliser la dernière version de développement de ComfyUI pour des résultats optimaux.

Configuration minimale pour faire tourner Wan AI avec ComfyUI

Pour exécuter Wan 2.2 d’Alibaba dans ComfyUI, vous devez installer manuellement les fichiers du modèle de diffusion, du VAE et de l’encodeur de texte. Suivez les étapes du guide officiel pour connecter chaque composant. Une carte graphique avec au moins 8 Go de VRAM est recommandée afin d’assurer une génération vidéo fluide avec le générateur IA Wan AI.

Options de workflow : T2V, I2V et hybride

ComfyUI prend en charge trois flux de travail vidéo Wan : texte-à-vidéo (T2V), image-à-vidéo (I2V) et hybride (TI2V). Chacun utilise une configuration de modèle différente. Vous pouvez choisir en fonction de votre type d'entrée et de vos objectifs de génération. Les paramètres de saisie, la longueur des images et la résolution peuvent tous être personnalisés dans le flux de travail.

Comment fonctionne Wan 2.2 ?

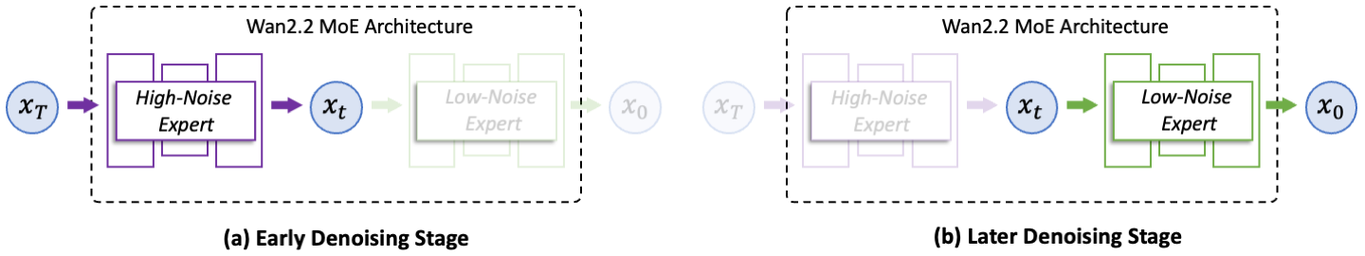

Architecture Mixture of Experts (MoE)

Wan 2.2 utilise une architecture Mixture of Experts (MoE) pour améliorer la qualité de génération sans augmenter le coût lié à l'inférence. Deux modèles experts spécialisés—un pour les bruits forts et un pour les bruits faibles—fonctionnent en séquence pour gérer les différentes étapes du processus de débruitage. Par rapport à Wan 2.1, cette conception améliore à la fois la mise en page et les détails fins, tout en maintenant l'utilisation de la mémoire stable sur les GPU standard.

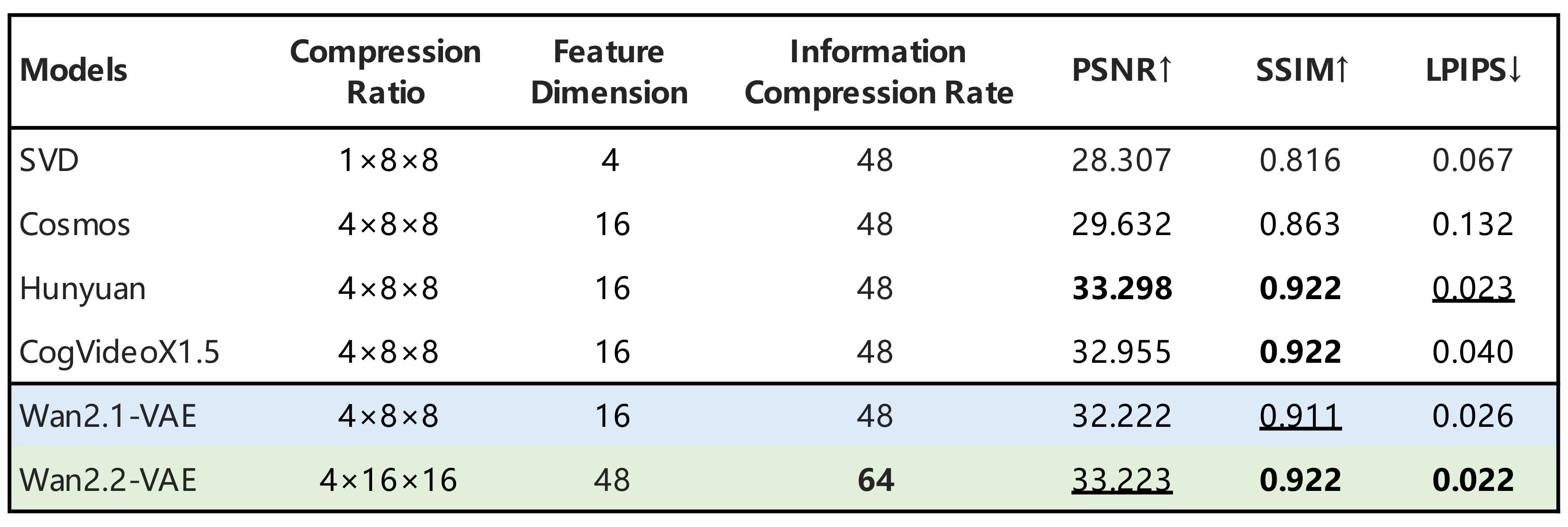

Modèle Hybride TI2V Haute Efficacité

Pour un déploiement plus rapide et plus léger, Alibaba Wan 2.2 introduit un modèle compact appelé TI2V-5B. Il utilise un VAE à haute compression pour délivrer des vidéos 720p à 24fps en moins de 9 minutes sur un GPU grand public. Cette version prend en charge aussi bien les tâches de conversion de texte en vidéo que celles d'image en vidéo, le tout dans un pipeline unifié.

Wan 2.2 vs Principaux Modèles de Vidéo IA

Comparé aux versions précédentes de Wan, Wan 2.2 présente une perte de validation significativement plus faible, ce qui signifie que les vidéos qu'il génère sont plus réalistes et mieux alignées avec les attentes visuelles humaines. Les tests de référence montrent que Wan IA surpasse plusieurs modèles propriétaires en termes de mouvement, de détails et de précision des invites.

Arrive bientôt : Intégration du Générateur de Vidéos IA Wan

Vous pouvez dès maintenant essayer gratuitement notre générateur de vidéos IA en ligne sur videomaker.me, sans inscription requise. Nous travaillons également à offrir un support complet pour le générateur de vidéos IA Wan 2.2, vous permettant bientôt de créer des vidéos de qualité cinématographique, grâce à la technologie avancée de Wan IA et des performances ultra-rapides.

FAQ sur Wan 2.2

Qu'est-ce que Wan 2.2 et qui l'a développé ?

Wan 2.2 est un générateur de vidéos IA open-source développé par Wan AI, une plateforme de recherche d'Alibaba. Il crée des vidéos de haute qualité à partir de texte ou d'images en utilisant une architecture multimodale avancée.

Qu'est-ce qui distingue Wan 2.2 de Wan 2.1 ou d'autres modèles ?

Wan 2.2 améliore la qualité et la vitesse de génération grâce à une architecture Mixture of Experts (MoE) et des techniques de haute compression. Il prend en charge une sortie 720P@24fps et offre un meilleur réalisme, des mouvements plus fluides et une meilleure précision des prompts par rapport aux principaux modèles commerciaux.

Quels modèles vidéo sont disponibles sous Wan 2.2 ?

Wan 2.2 propose trois modèles clés : T2V-A14B pour la génération de vidéos à partir de texte, I2V-A14B pour les tâches d'image en vidéo, et TI2V-5B, un modèle hybride qui prend en charge les deux modes avec une sortie de haute qualité.

Puis-je utiliser Wan 2.2 en ligne sans configuration ?

Oui. Vous pouvez essayer le modèle TI2V-5B via Hugging Face ou découvrir plus de fonctionnalités avec Wan 2.2 Plus sur le site officiel de WanVideo. Les deux options ne nécessitent aucune installation ou codage nécessaire.

Comment personnaliser le style visuel de ma vidéo ?

Wan 2.2 vous permet de personnaliser divers paramètres esthétiques tels que l'éclairage, la composition et la couleur pour créer des vidéos au style cinématographique unique.

Comment exécuter Wan 2.2 localement sur mon ordinateur ?

Pour exécuter Wan 2.2 localement, vous devrez cloner le repository GitHub officiel, installer des dépendances comme PyTorch 2.4.0 ou supérieur, et télécharger le modèle approprié (T2V, I2V ou TI2V). Une fois configuré, vous pourrez générer des vidéos à partir de prompts textuels ou d'images directement sur votre machine. Une carte graphique avec au moins 24 Go de VRAM est recommandée pour une performance fluide.

Wan 2.2 est-il complètement open-source ?

Oui, Wan 2.2 est complètement open-source, offrant aux développeurs, chercheurs et créateurs la possibilité d'explorer et d'adapter les modèles selon leurs besoins.

Puis-je exécuter Wan 2.2 sur une carte graphique grand public ?

Oui, Wan 2.2 peut être exécuté sur des cartes graphiques grand public telles que le RTX 4090, offrant une génération vidéo en haute définition à une résolution de 720P et 24 images par seconde.